저번주에 아쉬웠던 점 중 하나가 오전 시간을 제대로 활용하지 못한다는 점이었는데, 오늘 아침에는 밤에 돌려놓고 잤던 모델 결과를 확인하면서 나름 괜찮은 예측 결과가 나와서 신기했다. 그리고 2주차 ML LifeCycle 가 시작되면서 이번주는 무슨 일이 있어도 매일매일 학습 정리를 하기로 했기 때문에 시간을 틈내서라도 기록하려고 노력했다.

기본과제 1을 하면서 model fit 하는 과정에서 계속 램 용량 이슈 있어서 코랩 프로 결제했는데,, 알고보니까 shape 잘못 설정해서 그랬던 것이었다.. shape 잘못 설정했는데 역행렬 구하는 과정에서 오류 발생하면서 램 초과 일어났던 것 같다. 코드를 먼저 다시 봤어야 하는 건데,, ㅎ 잘못 설정되어있으면 error 발생되면서 바로 중지될 줄 알아서 잘못된 줄 몰랐다 ㅎ

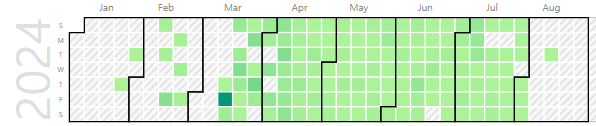

나름 열심히 칠했던 백준 잔디밭에 9개의 공백이 생겼다 ㅎ 오늘.. 부터 다시 채우면 되지 뭐 ~! 30분을 투자하는게 참 쉽지 않다 이건 마치 아침에 10분만 일찍 일어나면 모든게 여유로운데 그 10분이 어려운거랑 마찬가지지 뭐 ~

이번주는 크게 머신러닝 사이클과 RNN, 트랜스포머에 관해서 배웠다. 옛날에는 최적화기법 손실함수 역전파 다 따로따로 생각하고 정리가 안된 느낌이었는데, 이번 한 주를 통해서 아! 하나의 사이클이구나 서로 유기적으로 연결되어 있는 형태로 손실함수를 통해서 구한 손실값으로 최소화하기 위해 매개변수로 기울기를 구하고, 이를 최적화하기 위해 optimizer를 사용하고,, 등등 하나의 연결고리를 지어서 좀 정리가 된 한 주였다.

근데 여전히 트랜스포머는 어렵고,, self attention 또한 어려웠다. 그리고 과제를 진행하면서 행렬 단위로 학습이 진행되다 보니 shape 문제도 한번에 딱 생각해내기 어려웠다.

이번주 주말에는 attention 공부를 조금 더 하고, 코드상 NN 구현할 때 shape에 대해서 조금 더 정리를 해야겠다.

'AI Tech 7기 > 회고록' 카테고리의 다른 글

| [7주차] image classification 프로젝트 회고록 (2) | 2024.09.27 |

|---|---|

| [6주차] 회고록 (1) | 2024.09.13 |

| [4주차] 회고록 (0) | 2024.08.30 |

| [3주차] 회고록 (1) | 2024.08.25 |

| [1주차] 회고록 (0) | 2024.08.09 |

저번주에 아쉬웠던 점 중 하나가 오전 시간을 제대로 활용하지 못한다는 점이었는데, 오늘 아침에는 밤에 돌려놓고 잤던 모델 결과를 확인하면서 나름 괜찮은 예측 결과가 나와서 신기했다. 그리고 2주차 ML LifeCycle 가 시작되면서 이번주는 무슨 일이 있어도 매일매일 학습 정리를 하기로 했기 때문에 시간을 틈내서라도 기록하려고 노력했다.

기본과제 1을 하면서 model fit 하는 과정에서 계속 램 용량 이슈 있어서 코랩 프로 결제했는데,, 알고보니까 shape 잘못 설정해서 그랬던 것이었다.. shape 잘못 설정했는데 역행렬 구하는 과정에서 오류 발생하면서 램 초과 일어났던 것 같다. 코드를 먼저 다시 봤어야 하는 건데,, ㅎ 잘못 설정되어있으면 error 발생되면서 바로 중지될 줄 알아서 잘못된 줄 몰랐다 ㅎ

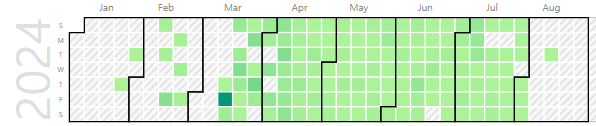

나름 열심히 칠했던 백준 잔디밭에 9개의 공백이 생겼다 ㅎ 오늘.. 부터 다시 채우면 되지 뭐 ~! 30분을 투자하는게 참 쉽지 않다 이건 마치 아침에 10분만 일찍 일어나면 모든게 여유로운데 그 10분이 어려운거랑 마찬가지지 뭐 ~

이번주는 크게 머신러닝 사이클과 RNN, 트랜스포머에 관해서 배웠다. 옛날에는 최적화기법 손실함수 역전파 다 따로따로 생각하고 정리가 안된 느낌이었는데, 이번 한 주를 통해서 아! 하나의 사이클이구나 서로 유기적으로 연결되어 있는 형태로 손실함수를 통해서 구한 손실값으로 최소화하기 위해 매개변수로 기울기를 구하고, 이를 최적화하기 위해 optimizer를 사용하고,, 등등 하나의 연결고리를 지어서 좀 정리가 된 한 주였다.

근데 여전히 트랜스포머는 어렵고,, self attention 또한 어려웠다. 그리고 과제를 진행하면서 행렬 단위로 학습이 진행되다 보니 shape 문제도 한번에 딱 생각해내기 어려웠다.

이번주 주말에는 attention 공부를 조금 더 하고, 코드상 NN 구현할 때 shape에 대해서 조금 더 정리를 해야겠다.

'AI Tech 7기 > 회고록' 카테고리의 다른 글

| [7주차] image classification 프로젝트 회고록 (2) | 2024.09.27 |

|---|---|

| [6주차] 회고록 (1) | 2024.09.13 |

| [4주차] 회고록 (0) | 2024.08.30 |

| [3주차] 회고록 (1) | 2024.08.25 |

| [1주차] 회고록 (0) | 2024.08.09 |